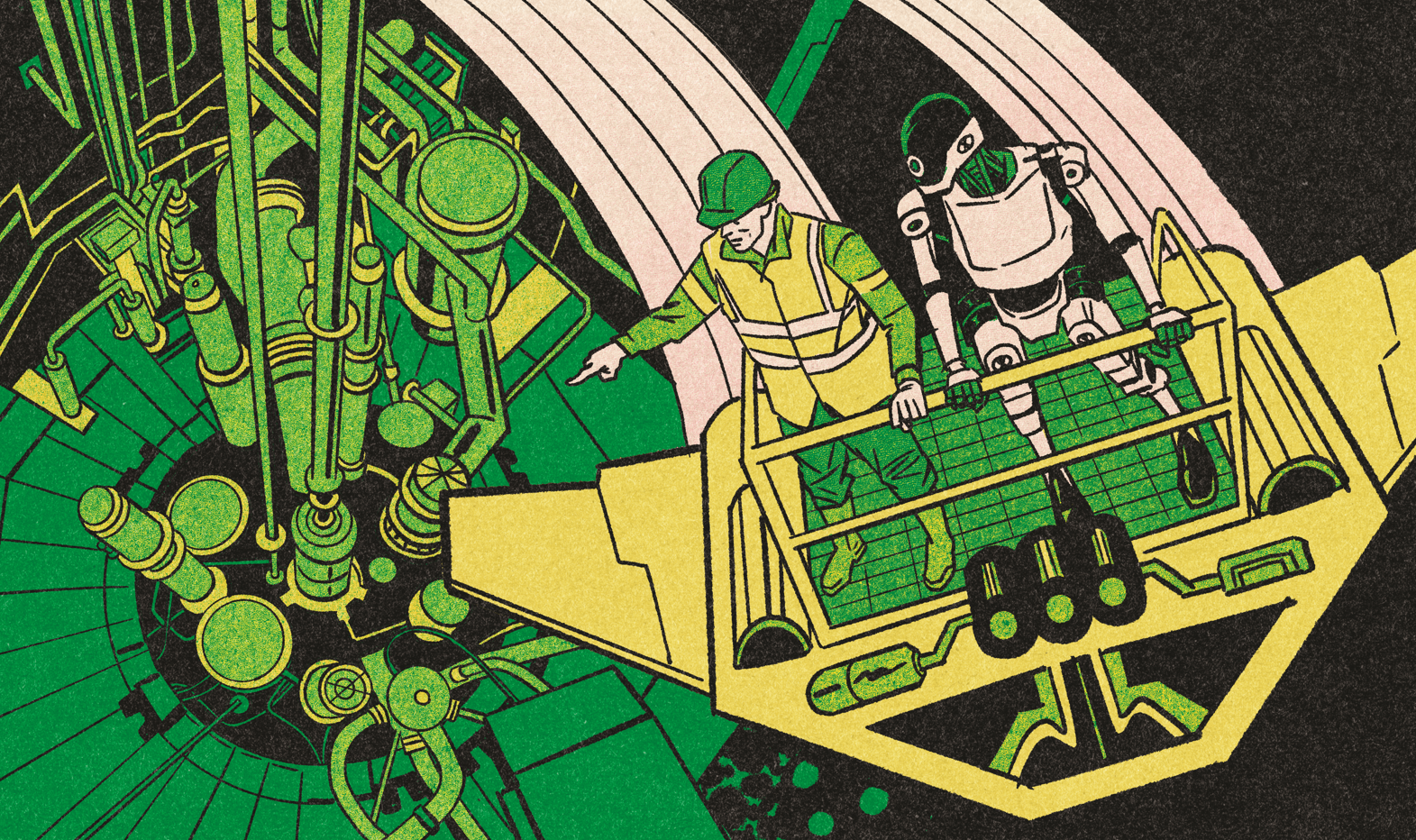

3. L’IA au service de l’inspection : un assistant, pas un remplaçant

Dans un contexte réglementaire complexe et évolutif, Bureau Veritas explore l’usage qui peut être fait de l’intelligence artificielle pour assister ses inspecteurs et non s’y substituer.

Entretien avec Laurent Balahy (directeur Métiers industrie et nucléaires), Jean-Pierre Durand (directeur Division nucléaire) et Ghislain de Frescheville (Project Leader For AI Evaluation).

Dans vos métiers, en particulier pour le travail préparatoire et la rédaction des rapports, avez-vous déjà utilisé l’IA ?

Elle est de plus en plus utilisée pour assister les équipes dans la préparation de leurs inspections, pour les aider à identifier les incohérences documentaires ou encore à relever des points sensibles ou des anomalies récurrentes. Mais attention, l’inspecteur reste le seul maître de son plan d’inspection et si l’IA est un bon assistant (exhaustif et rapide), elle doit être considérée comme un assistant junior, ce qui ne retire ni l’expertise et encore moins la responsabilité de l’inspecteur.

Nous disposons de notre propre outil d’IA basé sur un Large Language Model qui travaille en boucle fermée sur notre infrastructure. Cela permet de respecter nos obligations d’impartialité et de renforcer l’apprentissage sur nos métiers. Nous avons reçu une formation pour rédiger des prompts pertinents et avons des ambassadeurs IA par entités.

Pour la détection des fraudes, nous avons mis des fragilités ou la falsification de certificats. On constate que la fraude devient de plus en plus sophistiquée et difficile à détecter.

Comment vous assurez-vous de la maîtrise de l’outil et vous prémunissez-vous des éventuelles fraudes ?

La lutte contre la fraude est une priorité. Tous nos inspecteurs sont formés et responsabilisés sur le sujet. Considérant la rapidité de l’évolution de l’outil, des rappels et des remises à niveau fréquents et nombreux sont nécessaires. Nous encadrons de très près l’utilisation de l’IA pour éviter toute dérive. Nous avons notamment développé une culture de la transparence avec nos clients et avec les autorités. Nous utilisons également l’IA pour détecter d’éventuels signaux faibles dans nos rapports. Nous restons cependant en phase d’apprentissage. Nous ne souhaitons pas brûler les étapes. Par ailleurs, et il faut le rappeler, nous sommes extrêmement surveillés par l’ASNR, par les Directions régionales de l’environnement, de l’aménagement et du logement (DREAL), ainsi que par les organismes d’accréditation ou de certification. La dimension historique et cumulative des résultats des inspections forme un cadre idéal pour exploiter les REX et produire de la connaissance.

Comment envisagez-vous la gestion des connaissances avec ces nouveaux outils ?

Le but est d’exploiter cette « masse de données » pour rendre toujours plus pertinentes nos inspections. Sur le projet de Flamanville 3, nous avons lancé un travail d’analyse de nos rapports afin de nous permettre d’améliorer notre connaissance technique collective et de préciser nos grilles d’inspection. Nous testons également des outils de reconnaissance d’image pour aider les inspecteurs pour le contrôle d’armoires électriques simples. Cet outil d’IA Scanarel peut, à partir de la photo de la face avant de l’armoire ou d’un tableau électrique, détecter un changement de configuration et afficher automatiquement le plan de l’armoire tel qu’initialement construit.

Comment concevez-vous l’utilisation de l’IA dans vos métiers à plus long terme ?

Aujourd’hui, les contrôles réglementaires reposent sur deux points : la compétence individuelle et la robustesse du système de management de la qualité. Ce second point, du fait de l’alourdissement des systèmes d’accréditation ou d’agrément des organismes de contrôle, conduit à limiter l’autonomie de l’inspecteur et à standardiser les contrôles. Le recours à l’IA pourrait permettre de redonner de l’autonomie à l’inspecteur, tout en restant dans le cadre réglementaire, en le délestant des contrôles fastidieux et répétitifs et en lui permettant d’exercer son regard d’expert.

L’IA pourrait aussi, de façon neutre, synthétiser et exploiter les contrôles réalisés par les différentes parties et optimiser les plans d’inspection pour améliorer l’efficacité collective.

Et puis se pose la question majeure de l’appréhension générationnelle de l’outil. Les futurs ingénieurs préféreront sans doute poser une question à un système plutôt que d’ouvrir des livres volumineux, ce sera un comportement standard, il faut s’y préparer.

Que va changer concrètement l’AI Act pour les industriels ?

Parmi les grands changements qui se profilent, on peut mentionner la conformité de l’usage de l’IA avec l’AI Act européen. L’expérience de Bureau Veritas dans le domaine des Inspections et de la Certification peut aider des clients à se préparer à l’entrée en vigueur de ce dernier, par exemple en les aidant à objectiver et à fiabiliser leur IA, notamment lorsqu’elle est associée aux systèmes importants pour la sûreté. On connaît d’ores et déjà toutes les propriétés des systèmes IA devant être respectées pour limiter les risques et qui devront être contrôlées : robustesse, cybersécurité, transparence. À l’entrée en vigueur de l’AI Act, en août 20261, il faudra, dans certains cas, faire appel à des organismes certifiés lorsque l’IA contribue à la sûreté en accord avec les règles européennes ESP(N), ferroviaire, aéronautique et dès lors qu’une IA entre dans le champ réglementaire, en particulier pour les infrastructures critiques.

Il faut comprendre que pour fabriquer un système d’IA il y a trois acteurs principaux. Premièrement, l’éditeur fournissant le modèle d’IA. Deuxièmement, le fournisseur, celui qui développe le système embarquant le modèle d’IA. C’est lui qui est responsable du risk management system : il doit fournir une documentation technique volumineuse et montrer comment le système est « monitorable » par un contrôle humain. Troisièmement, le déployeur (celui qui l’utilise dans ses applications). Il va aussi endosser cette responsabilité. S’il modifie « substantiellement » le système d’IA après sa mise en service, il reprend le rôle du fournisseur en termes de responsabilité. Cela peut être le cas quand le système doit réapprendre des données d’entraînement adaptées à l’utilisation métier.

Face à la prolifération des chatbots LLM et d’autres applications, Bureau Veritas propose une évaluation indépendante de maturité en structurant l’analyse à partir de l’AI Act, pour une analyse de risque, et, pour chaque cas d’usage. Cela permet à l’entreprise de savoir si elle est sur la bonne trajectoire même si elle ne sait pas à ce jour garantir la conformité à la loi.

~~~

- La Commission européenne vient de proposer (« Digital Omnibus », 19 novembre 2025) de repousser cette échéance.